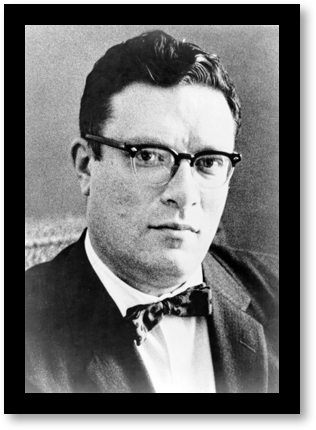

Prekursor: Isaac Asimov

Gdy w 1941 roku po raz pierwszy w historii użył terminu „robotyka”, nie spodziewał się, że inżynierowie będą zajmować się nią zaledwie 15 lat później.

Nie zmienia to faktu, że stworzone przez niego reguły postępowania robotów do dziś znajdują odzwierciedlenie w myśleniu o sztucznej inteligencji.

Prezentujemy sylwetkę Isaaca Asimova – wybitnego humanisty i twórcy trzech praw robotyki.

Jak podaje oksfordzki słownik języka angielskiego, termin „robotyka” został po raz pierwszy użyty w krótkim opowiadaniu pt. „Kłamca” opublikowanym przez Isaaca Asimova w piśmie Astounding Science Fiction w maju 1941 r. Autor przyznał później, że pisząc to słowo nie miał świadomości, że jest nowe – potraktował je jako oczywistą analogię do „mechaniki” czy „hydrauliki”. Niespełna rok później magazyn zamieścił „Zabawę w berka”, historię, w której pisarz zawarł „Trzy prawa robotyki”, stanowiące zasady postępowania skonstruowanych przez człowieka maszyn obdarzonych sztuczną inteligencją (AI od ang. artificial intelligence). Według nich:

- Robot nie może skrzywdzić człowieka, ani przez zaniechanie działania dopuścić, aby człowiek doznał krzywdy.

- Robot musi być posłuszny rozkazom człowieka, chyba że stoją one w sprzeczności z Pierwszym Prawem.

- Robot musi chronić samego siebie, o ile tylko nie stoi to w sprzeczności z Pierwszym lub Drugim Prawem.

Poruszone ponad 70 lat temu zagadnienia stają się zaskakująco aktualne dziś, gdy w kilku koncernach jednocześnie toczą się prace nad samochodami autonomicznymi, latają nad nami drony, a w magazynach coraz częściej pojawiają się samodzielne pojazdy takie jak iGo neo.

Prawa Asimova stały się punktem wyjścia dla wielu dzieł popkultury. Odnosi się do nich blockbuster „Ja, robot” z Willem Smithem, „Robocop” z 1987 czy cykl zapoczątkowany filmem Ridleya Scotta „Obcy: Ósmy pasażer Nostromo”. Jednak kwestiami etyki robotów „na poważnie” zajmują się dziś także rządowe agencje rozwiniętych krajów. W raporcie „Cyfryzacja jako wyzwanie i szansa dla państwa i administracji publicznej” niemiecki Instytut Badawczy na rzecz Administracji Publicznej stworzył projekt podstawy prawnej dla kontroli przez państwo algorytmów kierujących robotami. Działająca na zlecenie brytyjskiego gabinetu Horizon Scanning Programme Team w dokumencie „Sztuczna inteligencja: możliwości i implikacje dla przyszłości podejmowania decyzji” identyfikuje bariery mogące stanąć na drodze do zaakceptowania inteligentnych robotów przez ludzi. Jako kwestie wymagające debaty publicznej, autorzy wymieniają następujące zagadnienia:

- Jak traktować błędy popełniane wskutek użycia sztucznej inteligencji?

- Jak najlepiej zrozumieć probabilistyczny model podejmowania decyzji?

- W jakim stopniu można zaufać decyzjom podejmowanym bez wsparcia sztucznej inteligencji lub wbrew jej zaleceniom?

Jako minimum konieczne, by opinia publiczna zawierzyła, że użycie tej technologii jest bezpieczne i korzystne, Horizon Scanning Programme Team wymienia:

- Poprawne zidentyfikowanie wszelkich niekorzystnych efektów wykorzystania sztucznej inteligencji;

- Stworzenie funkcjonujących struktur formalnych i procesów udzielania obywatelom pomocy w razie błędów AI;

- Sposoby udzielania stosownej rekompensaty za błędy AI;

- Jasne określenie odpowiedzialności za działania AI;

- Szeroka i zrozumiała komunikacja wymiernych korzyści, jakie społeczeństwo może uzyskać dzięki wykorzystaniu sztucznej inteligencji.

Choć więc autonomicznie i stanowiące o sobie roboty wciąż jeszcze należą do przyszłości, kraje stawiające na innowacyjną gospodarkę przygotowują swoje systemy prawne na ich nadejście. Kto wie, może już za kilka lat sformułowane przez Asimova reguły trafią do obowiązujących kodeksów.